苹果刚刚为自家机器学习软件加入了新的条目,旨在从 iPhone、iPad、Mac 等设备上匿名收集使用信息,让其“规模化地学习隐私保护”(Learning with Privacy at Scale)。

苹果刚刚为自家机器学习软件加入了新的条目,旨在从 iPhone、iPad、Mac 等设备上匿名收集使用信息,让其“规模化地学习隐私保护”(Learning with Privacy at Scale)。在更高的层级下,“差分隐私”(differential privacy)允许苹果在不损害任何个人隐私的情况下,采集来自大量用户的众包数据。差分隐私有两种类型,中央(central)和本地(local),而苹果选择了后者。

这意味着从设备发送的数据都是随机化的,因而服务器永远不会看到或接收来自用户的原始数据。

当用户设置他们的设备时,苹果会明确询问其是否愿意在选择的基础上提供使用信息。如果某个用户选择了拒绝,苹果将不会手机数据,除非他们后续又选择加入。

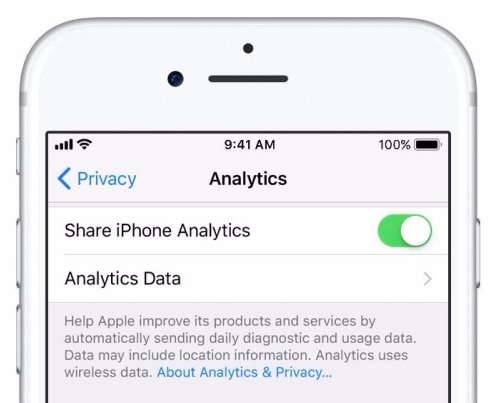

在 iOS 10 及后续版本的系统中,这个开关位于 “设定 -> 隐私 -> 分析”项下;在 macOS Sierra 及后续版本中,该开关位于“系统偏好 -> 隐私 -> 分析”项下。

苹果表示,其收集的数据有助于提升QuickType 输入法的单词预测和 emoji 建议,以及鉴定 Safari 中耗电过多、或消耗太多内存资源的问题网站。

举例来说,当用户输入一个 emoji 的手,或许会基于以下流程,触发使用信息的收集:

● 数据立即通过本地差分隐私被私有化;

● 借助一项叫做‘数据保护’的技术,将数据临时储存在设备上(详见 iOS 安全指南第 11 页);

● 在过了一段时间之后,会随机收集一个样本数据并发送到苹果服务器。

发送给苹果的信息中不包括设备标识、或使用信息中的事件发生时间戳,此外设备和服务器之间的连接也使用了 TLS 加密。

如有兴趣了解苹果使用的数学算法的详情,可点击这里查看原文:

https://machinelearning.apple.com/2017/12/06/learning-with-privacy-at-scale.html

网友评论