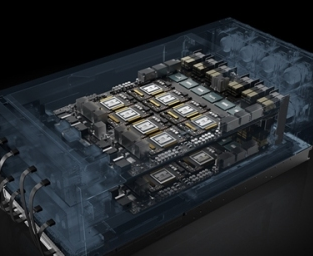

昨天,NVIDIA今天宣布推出新一代计算平台“HGX-2”,该平台拥有多达16块顶级计算卡Tesla V100,同时NVIDIA第一次将AI人工智能、HPC高性能计算融合在了统一架构之内,计算性能更加强大。

【PChome整机频道资讯报道】昨天,NVIDIA今天宣布推出新一代计算平台“HGX-2”,拥有多达16块顶级计算卡Tesla V100,而且第一次将AI人工智能、HPC高性能计算融合在了统一架构之内。

Tesla V100基于新一代GPU架构“Volta”(伏特),采用台积电12nm FFN(16nm加强版)工艺制造,拥有5120个CUDA核心、640个Tensor深度学习核心,面积达815平方毫米,集成了210亿个晶体管。

其浮点性能高达半精度30TFlops、单精度15TFlops、双精度7.5TFlops,Tensor性能则有120TFlops,同时搭配4096-bit位宽的16GB HBM2高带宽显存,频率1.75GHz,带宽900GB/s。

此前,NVIDIA推出的计算平台HGX-1整合了8块Tesla V100,总计40960个CUDA核心、5120个Tensor核心、256GB显存,通过300GB/s双线带宽的NVLink总线相连,浮点性能单精度125TFlops、双精度62TFlops,Tensor性能1PFlops。

新一代HGX-2则用上了16块Tesla V100,规模和性能轻松翻番,总计81920个CUDA核心、10240个Tensor核心、512GB显存,浮点性能单精度250TFlops、双精度125TFlops,Tensor性能2PFlops。NVIDIA还在系统内部署了12颗NVSwitches开关,用于GPU之间的直接互联,NVLink总线双向带宽高达2.4TB/s。

除了高性能,HGX-2平台的最大优点是支持多种精度计算,可适应不同需求,比如在科学计算和模拟中,可使用FP64、FP32高精度计算,而在AI训练和推理中,则可使用FP16浮点、Int8整数精度计算。

联想、超微、QCT、Wiwynn四大服务器厂商都将在今年晚些时候发售各自的HGX-2系统。富士康、英业达、广达、纬创四大ODM厂商则正在设计基于HGX-2的系统,将在今年晚些时候面世,可用于云计算数据中心。

网友评论