英特尔宣布于中国市场推出第二代Gaudi深度学习加速器——Habana Gaudi2。Gaudi2深度学习加速器的架构旨在高效扩展,以满足大规模语言模型及生成式AI模型的需求。

7月11日,英特尔正式于中国市场推出第二代Gaudi深度学习加速器——Habana Gaudi2。作为英特尔从云到端产品组合的重要组成,Gaudi2致力于以领先的性价比优势,加速AI训练及推理,为中国用户提供更高的深度学习性能和效率,从而成为大规模部署AI的更优解。

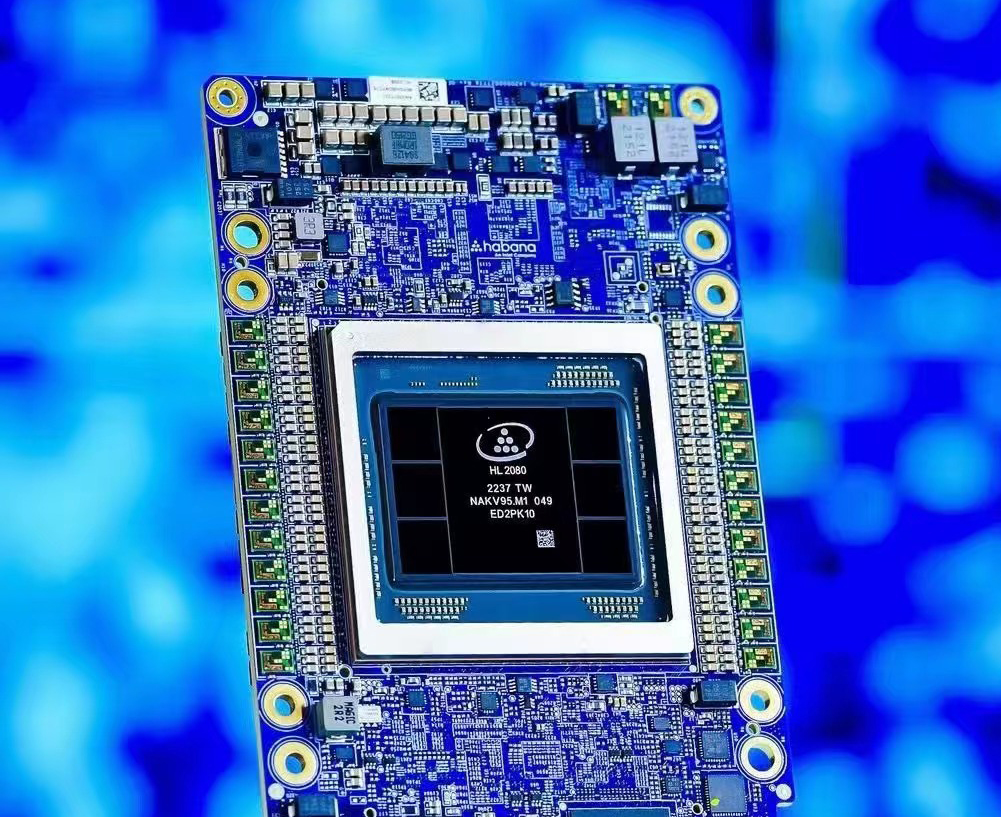

该Gaudi2深度学习加速器暨Gaudi2夹层卡HL-225B,以第一代Gaudi高性能架构为基础,以多方位性能与能效比提升,加速高性能大语言模型运行。该加速器具备:

·24个可编程Tensor处理器核心(TPCs)

·21个100Gbps(RoCEv2)以太网接口

·96GB HBM2E内存容量

·2.4TB/秒的总内存带宽

·48MB片上SRAM

·集成多媒体处理引擎

Gaudi2加速器的出色性能在6月公布的MLCommons MLPerf基准测试中得到了充分认证,其在GPT-3模型、计算机视觉模型ResNet-50(使用8个加速器)、Unet3D(使用8个加速器),以及自然语言处理模型BERT(使用8个和64个加速器)上均取得了优异的训练结果。与市场上其他面向大规模生成式AI和大语言模型的产品相比,Gaudi2拥有卓越的性能与领先的性价比优势,能够帮助用户提升运营效率的同时,降低运营成本。

Gaudi2深度学习加速器的架构旨在高效扩展,以满足大规模语言模型及生成式AI模型的需求。其每张芯片集成了21个专用于内部互联的100Gbps(RoCEv2 RDMA)以太网接口,从而实现低延迟服务器内扩展。

在Stable Diffusion训练上,Gaudi2展示了从1张卡至64张卡近线性99%的扩展性。此外,MLCommons刚刚公布的MLPerf训练3.0结果,亦验证了Gaudi2处理器在1750亿参数的GPT-3模型上,从256个加速器到384个加速器可实现令人印象深刻的接近线性的95%扩展效果。

伴随日益增长的生成式AI及大语言模型需求,英特尔亦致力于打造领先、成熟的软件支持,充分释放Gaudi2深度学习加速器性能。 为支持客户轻松构建模型,或将当前基于GPU的模型业务和系统迁移到基于全新Gaudi2服务器,并帮助保护软件开发投入,SynapseAI软件套件针对Gaudi平台深度学习业务进行了优化,旨在与广泛的软件生态系统一起,帮助简化模型的开发和迁移。SynapseAI集成了对TensorFlow和PyTorch框架的支持,并提供众多流行的计算机视觉和自然语言参考模型,能够满足深度学习开发者的多样化需求。

目前,英特尔正与浪潮信息合作,打造并发售基于Gaudi2深度学习加速器的浪潮信息AI服务器NF5698G7。该服务器集成了8颗Gaudi2加速卡HL-225B,还包含双路第四代英特尔至强可扩展处理器。美团、百度与浪潮信息等生态伙伴分别分享了其基于英特尔软硬件产品组合的多样化智能业务进展。未来,英特尔将持续引领产品技术发展,进一步加速大规模深度学习部署,助力中国本地AI市场发展。

网友评论