得益于Intel VRAM可变显存技术,Z-Image-Turbo与Intel集成显卡平台形成了一种高度契合的组合。在文生图这类典型的显存敏感型任务中,该技术显著提升了Intel平台的实用性,使集成显卡从只能尝试变为可以稳定使用。

近年来,随着AI大模型的快速发展,越来越多的用户使用AI来辅助工作、提高效率。以文生图模型为例,生成的图片质量越来越高,比如以下几张:

(提示词:微距视角,一只瓢虫停留在绿色叶片边缘,翅膀纹理清晰,水珠附着在叶脉上,背景完全虚化,超高细节微距摄影)

(提示词:一位短发女性站在雨后的城市街头,皮肤细节真实,发丝微湿,霓虹灯光在背景中形成散景,雨水倒影映在地面,电影感构图,超写实人像摄影)

(提示词:一只英短蓝猫蜷缩在落地窗旁的木质窗台上,柔和的午后阳光透过白色纱帘洒在猫咪毛发上,毛发细节清晰可见,眼睛呈现琥珀色高光,环境安静温暖,电影级色彩)

(提示词:一张商业海报,精致的玻璃香水瓶子位于画面中央,背景是绿色的棕榈背景,带有浅景深虚化效果,香水瓶上有露珠,氛围梦幻精致,8K级清晰度)

你能相信这是由一台没有独立显卡的集显轻薄型笔记本,使用仅6B参数的大模型生成的吗?

没错,以上图片是一台搭载酷睿Ultra 7 255H处理器与32GB内存的笔记本,使用Z-Image-Turbo模型生成的,并且单张图片耗时甚至小于1分钟,这个速度已经与一些云端模型服务商的速度和质量相媲美,并且是完全离线运行的。

Z-Image-Turbo是前不久由阿里通义实验室发布的新一代文生图模型,强调高质量+高速度,推理步数更少,并且支持中英文Prompt的准确理解与渲染。

另外就是Z-Image-Turbo在较低采样步数下即可生成结构完整、细节清晰的图像,相较传统SDXL模型,显存占用更低,更适合非高端GPU上运行。同时ComfyUI原生支持Z-Image-Turbo的节点化流程部署,因此,这个模型非常适合跑在本地。

而实现在集显轻薄本上运行的关键因素,还有一点:Intel的可变显存技术。在大家的传统认知中,文生图模型通常依赖大显存独立显卡,而Intel的VRAM可变显存打破了这一限制,使集成显卡能够在显存紧张场景下动态调用系统内存,为大模型推理提供“大显存相当”的能力。

在最新版的Intel Graphics Software驱动程序中,提供了共享GPU内存容量的调节选项,最多可以分配87%的系统内存给到iGPU,也就是说在这台32GB内存的笔记本上,iGPU最多可以利用27GB的内存作为VRAM。从而大大加速本地模型的推理速度,相当于笔记本有了一块大显存的GPU。

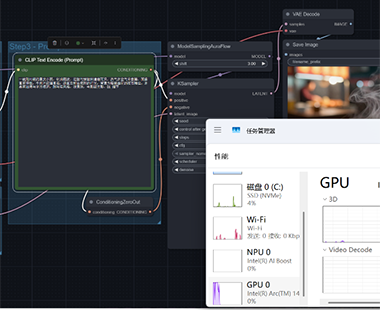

使用ComfyUI部署Z-Image-Turbo的流程也非常简单,完成以上VRAM“动态可变”设置之后,将官方发布的模型文件放入ComfyUI指定目录,直接加载Z-Image-Turbo生图模板即可。通过Prompt进行关键词输入,在采样器、解码器等模块中调节设置,以及可设定图像大小。整个部署过程无需复杂编译,对熟悉ComfyUI的用户而言,上手成本较低。

连续出图十次,速度非常稳定

实际的运行效果是超出我们预期的。以1024*1024像素的分辨率、9步采样为例,首次加载模型需要大约2分钟,其后单图生图时间在1分钟之内,并且连续出图非常稳定,无明显存溢出或崩溃。

相反,如果未启用VRAM动态显存扩展,集成显卡很容易在模型加载阶段出现显存不足问题。启用之后,模型推理过程中的显存压力被有效分摊到系统内存中,更加平稳。对于日常创作、概念设计、中文内容生成等应用场景,这一速度已经具备较强实用价值。

从结果来看,Intel VRAM可变显存技术,是本次成功运行Z-Image-Turbo的关键因素之一。从此,集成显卡不再受限于预设显存大小,而是可根据负载动态申请系统内存。使得原本需要8GB甚至更高显存的模型,能够在iGPU环境中顺利运行,同时也降低了推理过程中的显存抖动。

更多作品赏析:

(提示词:一位戴着老花镜的修鞋匠坐在狭窄的街巷里,双手布满老茧,专注地缝补一只旧皮鞋,背景是斑驳的红砖墙和褪色广告画,真实生活质感,纪实摄影风格)

(提示词:一座寿司城市,建筑由三文鱼、金枪鱼和米饭构成,旁轴摄影,道路是海苔,人物像玩偶般在城市中行走,色彩鲜艳,细节丰富,童话感,高分辨率插画)

(提示词:水墨画风格的山水画,远山如黛,云雾缭绕,近景为松树与溪流,墨色浓淡变化自然,留白充足,一叶小舟静静漂浮在水面,宣纸肌理明显,东方写意风格)

(提示词:欧式古典油画风格,一只表情庄重的柯基犬端坐在深色背景前,佩戴复古丝绒领结,厚重油画笔触,文艺复兴时期肖像构图,质感强烈)

综合来看,得益于Intel VRAM技术,Z-Image-Turbo与Intel集成显卡平台形成了一种高度契合的组合。在文生图这类典型的“显存敏感型”任务中,该技术显著提升了Intel平台的实用性,使集成显卡从“只能尝试”变为“可以稳定使用”。最关键的是支持中文、完全本地、无需联网,并且速度令人满意,大大降低了大模型创作的硬件门槛,也为Intel平台在生成式AI场景中的应用提供了新的可能。对于希望低成本、本地化部署文生图能力的用户而言,这无疑是一种非常值得尝试的部署方式。

(文中部分图片由AI生成)

网友评论